提升AI鲁棒性是识别深度伪造的有效途径

深度伪造(Deepfake)是深度学习(deep learning)和伪造(fake)的合成词,最初是指基于深度学习的人像合成技术,随着技术进化,深度伪造已经发展到对视频、声音、文字和微表情等多模态视频伪造的欺骗技术。

由于深度合成的图像、视频、音频、文本等内容制作成本低、操作简单、逼真程度高,被大量用在网络黑产对银行的身份欺诈攻击;另一个方面,机器学习往往需要大量的高质量训练数据来提升模型的准确性,但是AI在数据量有限的情况下,其性能就会受到很大局限,对形式多样的深度伪造内容的甄别难度极大。

对抗训练可以显著提升模型的鲁棒性

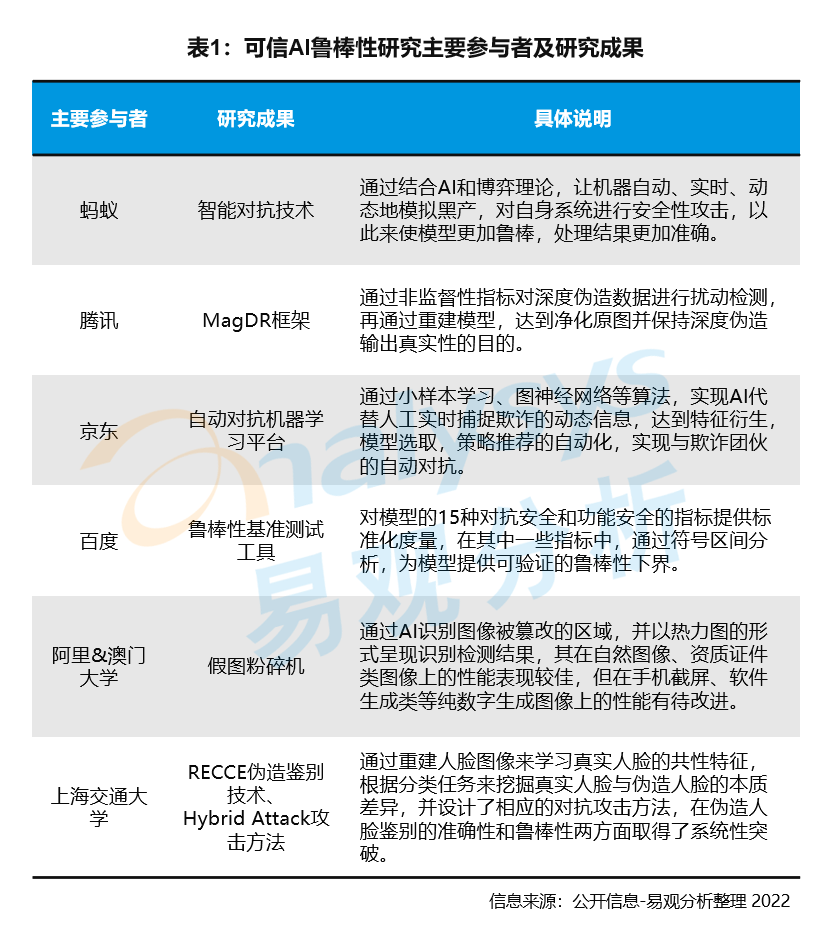

对抗训练作为抵御对抗攻击的有效方法,可以在模型训练中直接加入对抗样本进行学习,得到一个“增强模型”,从而防御对抗样本和伪造样本,提高AI对于新数据、新场景的泛化能力。目前国内人工智能领域在鲁棒性研究方面已经取得了一些成果,并可应用在金融领域客户身份识别、证照鉴别、反欺诈、模型评估等场景中。

根据扰动的类型来选择相应的技术路线

银行的技术使用者在应用AI进行语音、文本或图像的鉴别时,需要区分扰动的类型是善意还是恶意的,从而可以选择相应的技术路线来提升AI的可信度。

善意的扰动是由于客观环境原因造成原始数据质量不佳造成的,导致AI的模型决策产生了偏离和错误。在银行实际应用场景中,智能客服需要面对不同的客户、不同光照环境的照片、不同的语言表达习惯等,当这些待处理的数据发生了微小变化后,缺乏鲁棒性的AI识别能力和精确度就会明显下降。这种情况下,建议通过技术手段来改善图像本身的质量,将原始数据转化为模型可以理解的格式后再进行识别;另外,在模型训练中将知识驱动和数据驱动结合起来,通过抽取、表达后协同大量数据进行计算,形成更为精准的模型。

恶意的扰动则是故意通过深度合成伪造图像,或是在真实图像中添加特定噪声产生对抗样本,对银行进行的欺诈攻击。面对这种类型的扰动,建议技术使用者选择AI对抗攻防工具进行伪造样本的检测,识别图像是否被篡改,建立合适的风控策略进行实时预警或拦截;在选择伪造检测产品时,需要考量产品对不同类型对抗样本的攻击拒绝率和准确率,以及数据类型的兼容性、运算速度等性能方面的表现,结合不同业务场景的风控要求来进行综合评估。